Para facilitar la exposición, por el momento discutiremos solamente el caso univariado, dejando el caso general para la Sección 3.3.

Supongamos que se desea calcular la integral

| N | ||

| 2 | 0.7071067812 | 8.8622693

|

| 3 | 0.0000000000 | 1.1816359 |

| 1.2247448714 | 2.9540898

|

|

| 4 | 0.5246476233 | 8.0491409

|

| 1.6506801239 | 8.1312835

|

|

| 5 | 0.0000000000 | 9.4530872

|

| 0.9585724646 | 3.9361932

|

|

| 2.0201828705 | 1.9953242

|

Notemos que

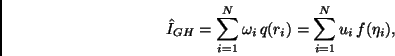

Esta regla elige los nodos y los pesos de manera que la aproximación

sea exacta si ![]() es un polinomio de orden a lo más

es un polinomio de orden a lo más ![]() en

en ![]() . Es posible extender esta técnica para evaluar integrales

cuyo integrando es de la forma

. Es posible extender esta técnica para evaluar integrales

cuyo integrando es de la forma

Si ![]() y

y ![]() son desconocidos también lo serán los

nodos

son desconocidos también lo serán los

nodos

![]() . Sin embargo, es posible estimar

. Sin embargo, es posible estimar ![]() y

y ![]() iterativamente de la siguiente forma (Naylor y Smith 1982):

(i) elegir valores iniciales

iterativamente de la siguiente forma (Naylor y Smith 1982):

(i) elegir valores iniciales ![]() y

y ![]() ;

(ii) utilizar (8) con

;

(ii) utilizar (8) con

![]() y

y

![]() para actualizar los valores de

para actualizar los valores de ![]() y

y ![]() ,

respectivamente;

,

respectivamente;

(iii) repetir el paso anterior hasta que los valores de los estimadores

se estabilicen.