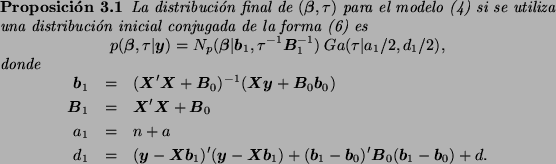

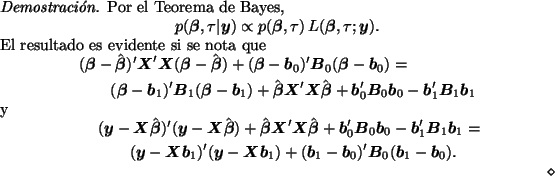

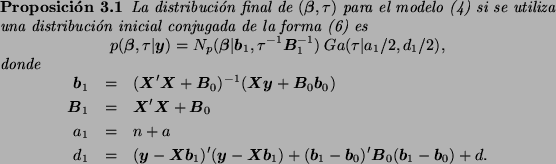

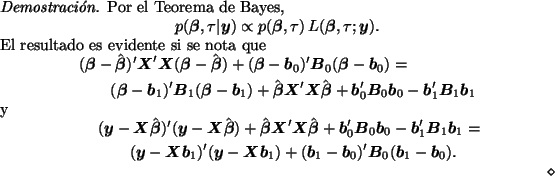

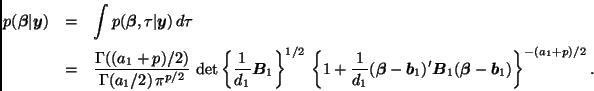

De acuerdo con este resultado, la distribución marginal final de ![]() es

es

Por otro lado, si se desea hacer inferencias sobre ![]() entonces

es necesario calcular su distribución marginal final, dada por

entonces

es necesario calcular su distribución marginal final, dada por

Distribución final de referencia

Recordemos que la distribución inicial de referencia,

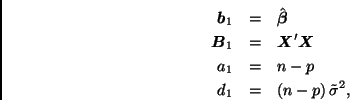

![]() , corresponde a un caso

límite de la familia conjugada (6) con

, corresponde a un caso

límite de la familia conjugada (6) con

![]() ,

, ![]() y

y ![]() . Aunque es impropia, ésta

da lugar a una distribución final propia siempre y cuando

. Aunque es impropia, ésta

da lugar a una distribución final propia siempre y cuando

![]() . De hecho, en este caso se tiene que

. De hecho, en este caso se tiene que